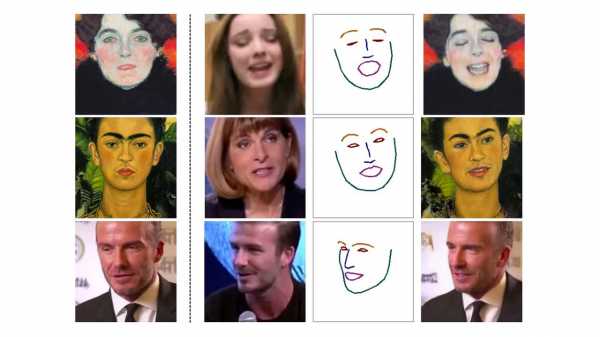

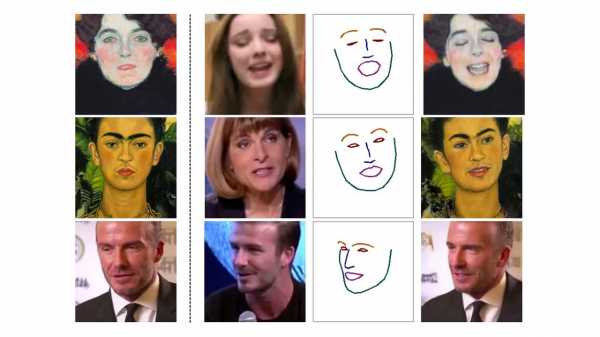

Российские ученые разработали систему на основе машинного обучения, которая "оживляет" людей на картинах и фотографиях. Чтобы реалистично анимировать портрет, алгоритму хватит всего одного кадра с изображением лица.

Новый метод применения ИИ изобрели ученые Центра искусственного интеллекта Samsung AI Center в Москве. Суть его заключается в том, чтобы наложить данные о движении лица с видео — подойдет любая "говорящая голова" — на любое статическое изображение. На выходе получается так, что целевое лицо в точности повторяет мимику исходного, пишет TechCrunch.

Результат выглядит довольно убедительно, хоть и несколько жутковато. Так, например, исследователи анимировали "Джоконду" ("Мону Лизу") Леонардо да Винчи, использовав три разных видеоисточника:

Похожие ИИ-модели создавались и ранее, но им требовалось значительное большее количество входных данных: не менее 1–2 минуты оригинального видео. Чем большим объемом информации располагает алгоритм, тем правдоподобнее будет результат.

Нейросеть заработала сотни тысяч долларов, нарисовав картину читайте также

Например, убедительная видеоподделка была создана в начале этого года. Воспользовавшись нейросетевым алгоритмом deepfakes, энтузиасты наложили лицо президента США Дональда Трампа на актера Алека Болдуина, пародировавшего политика на телешоу Saturday Night Live. Результат получился впечатляющим: поддельный Трамп весьма достоверно повторяет мимику и движения рук оригинала.