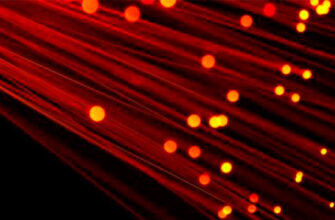

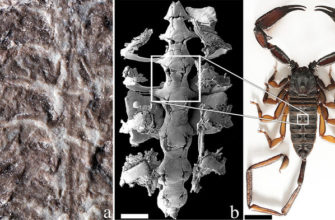

В карах Tesla нашли уязвимость. Исследователи из Tencent Keen Security Lab выпустили отчет, в каком тщательно поведали о собственных атаках на программное обеспечение, включая дистанционное вмешательство на управление рулем и выезд на встречную полосу из-за маленького стикера на дорожной разметке.

Спецы смогли показать, как маленькие, в главном неприметные для человека детали, приводят к тому, что системы машинного обучения допускают тяжелейщие ошибки. К примеру, добавив маленький шум к дорожной разметке, они смогли одурачить автопилот, который вполне растерял полосу из вида. При всем этом для человека не составило труда увидеть и найти правильную дорожную разметку и не сбиться с пути.

Но самый ужасающий итог вышел в итоге использования малеханьких наклеек на дороге, которые околпачили автопилот и направили его на встречную полосу. Подробности – в программке Вести.net.